- 02/04

- 2021

-

QQ扫一扫

-

Vision小助手

(CMVU)

事件摄像机是受生物启发的视觉传感器,输出像素级亮度变化,而不是标准亮度帧。这些相机不会受到运动模糊的影响,并且具有非常高的动态范围,这使得它们能够在高速运动期间或在以高动态范围为特征的场景中提供可靠的视觉信息。然而,当运动量有限时,例如在几乎静止运动的情况下,事件摄像机仅输出很少的信息。相反,标准相机在大多数情况下(在低速和良好照明的情况下)提供关于环境的即时和丰富的信息,但是在快速运动或高动态范围或弱光场景等困难照明的情况下,它们会严重失败。在本文中,我们提出了第一个状态估计系统,它通过以紧密耦合的方式融合事件、标准帧和惯性测量,利用了这两个传感器的互补优势。我们在公开可用的事件摄像机数据集上显示,我们的混合系统比仅事件系统的精度提高了130%,比仅标准帧的视觉惯性系统的精度提高了85%,同时仍然在计算上易于处理。此外,据我们所知,我们使用我们的系统演示了第一次使用事件摄像机进行状态估计的自主四旋翼飞行,解锁了传统视觉惯性里程计无法到达的飞行场景,如微光环境和高动态范围场景。

介绍

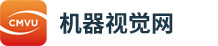

在这项工作中,据我们所知,我们提出了第一个融合所有三个传感器的状态估计系统,并在此基础上提出了第一个四旋翼系统,该系统可以有利地利用这种混合传感器组合,仅使用机载传感和计算在困难的情况下飞行(图1)。

在这项工作中,我们专注于困难的场景,并首次展示了(1)在计算有限的平台上使用事件摄像机运行状态估计是可能的,以及(2)我们展示了它可以在一系列困难的场景中解锁甚至商业系统都难以实现的自主飞行的可能性.

具体来说,我们在本文中的贡献有三个方面:

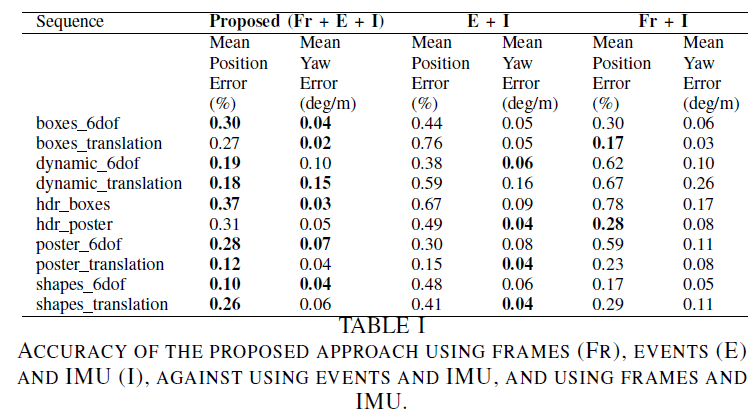

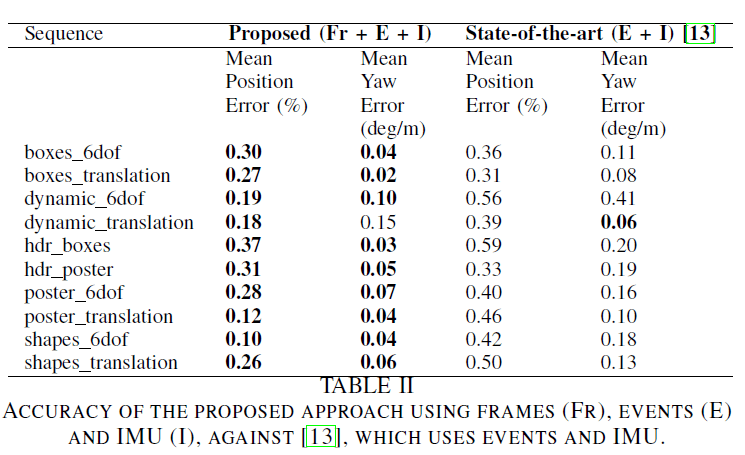

我们引入了第一个状态估计系统,它融合事件、标准帧和惯性测量,以提供鲁棒和准确的状态估计。虽然我们的系统是基于[13]的,但我们扩展了它,将标准帧作为附加的传感模式,并提出了几项改进,使其可用于实时应用,重点是移动机器人

我们对所提出的方法进行了定量评估,并表明使用标准帧作为附加模态提高了状态估计的准确性,同时保持了计算负载的可处理性。

我们证明了我们的方法可以应用于自主四旋翼飞行器的状态估计,并在一组实验中证明了所提出的系统能够在诸如弱光场景或快速运动等具有挑战性的情况下可靠地飞行.

我们的工作旨在强调事件摄像机在鲁棒状态估计方面的潜力,我们希望我们的结果将激励其他研究人员和行业推进这项工作,使事件摄像机在移动机器人上得到广泛应用.

带有事件摄像机的四旋翼飞行器

为了在真实场景中展示我们基于框架和事件的混合系统的潜力,我们在自主四旋翼飞行器上运行了我们的方法,并使用它在挑战性条件下自主飞行.

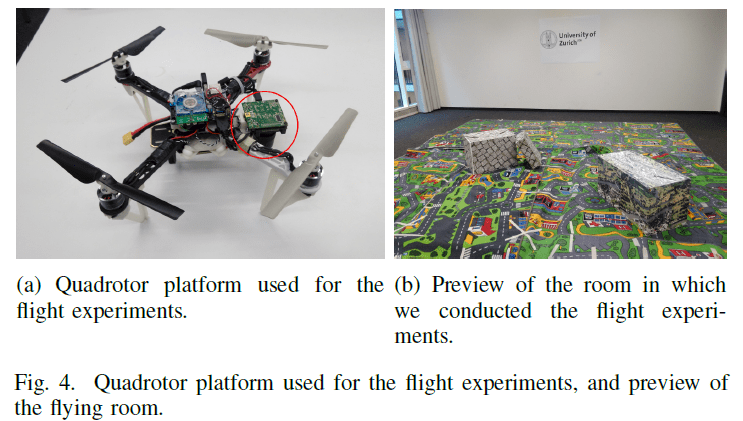

1平台

我们用精选的现成组件和定制的3D打印部件建造了四旋翼飞行器(图4(a))。我们的四旋翼飞行器依赖于一个DJI框架,配有遥控马达和增强现实无人机螺旋桨。我们四旋翼飞行器的电子部件包括PX4FMU自动驾驶仪[33]。此外,我们的四旋翼飞行器配备了一台Odroid XU4计算机,其中包含一个运行Ubuntu 14.04和ROS [34]的2.0 GHz四核处理器。最后,阿达VIS 240C传感器,配有70°视场镜头,安装在四旋翼飞行器的前部,向下看。传感器通过USB 2.0电缆连接到Odroid计算机,并传输事件、标准帧和惯性测量值,我们使用这些信息使用我们建议的管道来计算Odroid上的状态估计。由于DAVIS可用的ROS驱动程序没有标准相机的自动曝光,我们实现了自动曝光算法,并使其开源供社区使用。

2飞行实验

我们提出了三个飞行实验,证明我们的系统能够在具有挑战性的条件下驾驶四旋翼飞行器:(一)在室内飞行,同时打开和关闭灯(这是具有挑战性的,因为在人造光关闭后,由于灯的切换和室内非常低的光,照明突然发生很大变化);(ii)在光线不足的房间内快速转圈时;㈢悬停在相同的位置(这对于事件摄像机是有挑战性的,因为几乎没有运动)。在第一种情况下,当灯关闭时,标准帧是完全黑色的。在第二种情况下,四旋翼飞行器的速度在标准帧上引起严重的运动模糊。然而,在这两种情况下,事件都不受影响,我们的管道能够成功地利用它们来提供鲁棒的状态估计。在第三种情况下,相反,几乎没有运动,这使得事件摄像机难以跟踪可靠的特征。然而,帧不受影响,我们的管道能够成功地利用它们来提供鲁棒的状态估计。

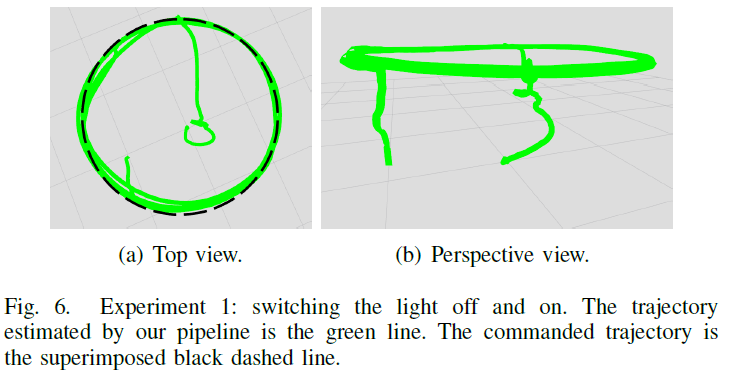

1)在飞行中关闭和打开灯

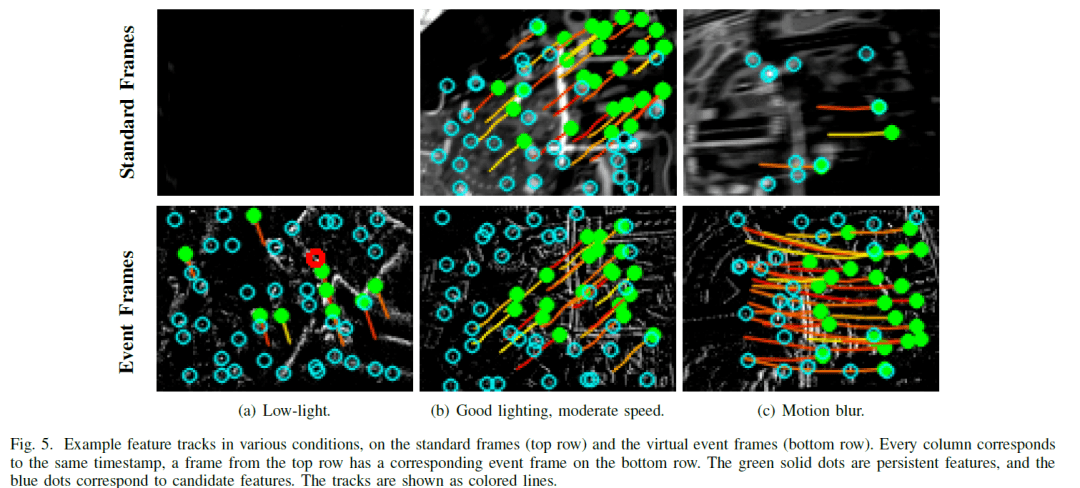

在这个实验中,我们通过在自主绕圈飞行的同时直接关闭房间灯,将我们的系统推到了极限。唯一剩下的光是来自窗户的残余光(非常少的光,但仍然足以让活动摄像机工作)。当灯熄灭时,标准帧变成完全黑色(图5(a)中的顶部帧),使得它们对于状态估计无用。相比之下,事件仍然携带足够的信息(尽管噪声更大),以允许合理的特征跟踪(图5(a))。关闭灯有效地迫使系统仅依赖事件和惯性测量.

四旋翼飞行器的飞行轨迹如图6所示

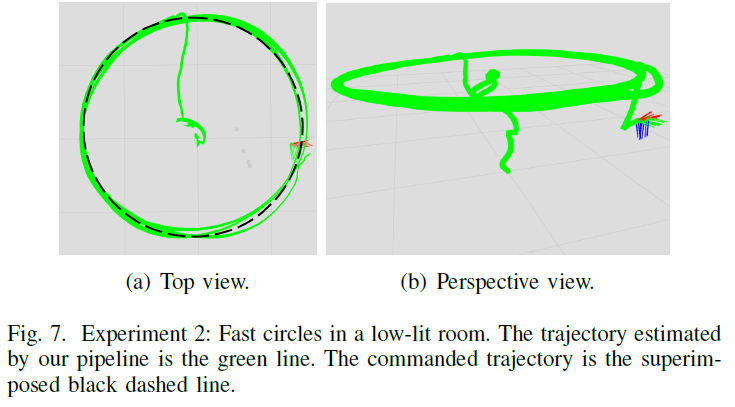

2)低光照房间

在本实验中,四旋翼飞行器在光线很少的封闭房间中自主地以递增的速度飞行一个圆形轨迹(图1);我们在晚上进行了这个实验,并在房间里设置了一个低照度。四旋翼飞行器的圆形轨迹由半径和期望的角速度参数化。我们把角速度设置为1.4弧度/秒,半径为1.2米的圆,对应于1.68米/秒的顶部线速度。圆的高度为1.0米。在该速度和高度下,在图像平面上产生的光流达到大约340像素/秒

虽然速度在轨迹开始时保持适中(低于1.2 m/s),但标准帧不会受到运动模糊的影响,并且我们的系统确实跟踪标准帧和事件帧中的特征(分别参见图5(b)中的顶部和底部帧)。然而,一旦速度增加,标准帧开始遭受严重的运动模糊,如图5(c)的顶部帧所示,并且在标准帧中跟踪的特征数量显著减少。相反,事件允许合成无运动的虚拟事件帧,这又允许保持可靠的特征轨迹(图5(c)中的底部帧)。

在图7中,为了比较,展示出了期望轨迹和估计轨迹.有趣的是,轨迹的右边比左边略嘈杂,这与房间内的灯光配置非常匹配:房间的左侧确实比右侧更明亮(在图1中可见).

3)悬停

我们还提供定性实验来展示我们的管道在接近无运动条件下的表现,这通常是在无人机悬停时遇到的。

首先,我们命令无人机悬停,同时使用仅事件管道,并观察状态估计漂移。然后,我们使用图像和事件帧命令无人机悬停,并观察无人机成功保持其位置,没有明显的漂移。

不同之处在于,特征在标准帧上被成功跟踪,而在事件帧上被丢失。这是因为,与标准相机不同,事件相机跟踪的特征的外观可能会随着运动的方向而急剧变化,这正是悬停时发生的情况:振动会导致运动方向的频繁变化,这会缩短事件流中特征轨迹的长度,从而导致漂移增加。

我们引入了第一个混合系统,它融合事件、标准帧和惯性测量,以产生鲁棒和准确的状态估计。

与仅使用事件加惯性测量单元相比,精度提高了130 %,与仅使用标准帧加惯性测量单元相比,精度提高了85 %。此外,我们成功地将所提出的用于计算受限的四旋翼飞行器上的状态估计的系统集成在一起,并使用它来实现,据我们所知,这是使用事件相机的四旋翼飞行器的第一次闭环飞行.最后,在一组具体的实验中,我们展示了我们的混合系统能够利用标准摄像机和事件摄像机的属性,在多种条件下飞行时提供鲁棒的跟踪,例如悬停、快速盘旋或在光线不足的房间中飞行.