- 06/10

- 2008

-

QQ扫一扫

-

Vision小助手

(CMVU)

摘 要:三维人体运动跟踪问题是一个复杂的高维非线性问题,本文针对三维人体运动重建的主要困难,通过对人体运动捕获数据的降维、聚类挖掘出人体运动的经验模型,在低维空间中以高斯混合模型表示人体运动参数的密度分布,然后与图像信息相结合,在生成式重建的框架内,以粒子滤波作为优化方法,重建出与序列图像对应的三维人体姿态。

关键词:高斯混合模型;人体运动分析;三维重建;粒子滤波;运动人体跟踪;序列图像

1 引 言

基于序列图像信息的三维人体运动跟踪由于其潜在的广阔应用前景和技术上的挑战成为近年来机器视觉领域的研究热点。人体运动重建的困难主要来自两个方面:一是来自图像主体——人体的困难,人体本身的结构复杂性和运动复杂性决定了这是一个高维的复杂非线性问题;二是来自图像信息源的困难,包括图像的模糊性、复杂动态背景的处理、图像人体的遮挡以及单目图像深度信息的缺失等。为了克服这些困难,除了依赖图像信息外,还需要结合人体结构和人体运动的先验知识。从已知的运动捕获数据中挖掘人体运动的有用先验知识,然后结合图像信息解决运动重建问题是近年来的研究趋势,对于序列图像情形,先验的人体运动动态模型尤其重要。

降维和动态模型的学习是人体运动重建中的两个重要方面,如Urtasun[1, 2]的方法把很多相似运动的运动捕获数据通过手工找关键帧和插值法形成相位对齐、帧数相同的运动序列集合,然后用PCA(主元分析)降维,最后以时间为索引恢复整个序列的姿态参数,这类方法的缺点是无法避开繁琐的插值和手工对齐序列的操作,但有低维空间下计算复杂度较低的优势;与文献[3]方法相似,Agarwal[4]对运动捕获数据则先聚类再降维,然后在降维后的空间内学习一个二阶自回归模型,其动态模型的学习过程比较复杂,而且最后的姿态重建还是要回到高维空间中进行。

本文在生成式重建的框架下,提出了一种基于高斯混合模型的有效重建方法。方法利用已知的样本序列人体运动捕获数据,用PCA把高维的人体姿态参数降到低维空间,这样首先达到了约简姿态参数维数的目的;然后再分割低维空间,即在低维的姿态空间中通过k-means(k均值聚类)把人体姿态参数分为几个典型的与不同运动阶段对应的类,至此,人体姿态参数可以看作是低维空间中的具有多峰分布(峰的数目与聚类数相关)的随机变量,每个峰可以用一个高斯分布近似,其均值与方差通过类内数据得到,因此,用高斯混合模型可以准确地描述姿态参数的分布。图像序列的跟踪基于贝叶斯规则下的生成式方法,使用粒子滤波作为优化方法。

2 模型描述

2.1 人体姿态表示

人体姿态表示方法是姿态重建中的一个重要方面。目前主要的人体姿态描述手段是先验三维人体模型,综述文献[5]以列表的方式对各种人体模型做了总结。

本文中的人体模型以图形学中的隐式曲面为人体表面的描述手段,即人体表面被描述为建立在人体骨架基础上的等势面[6]。对于动态序列图像的人体运动跟踪来说,每个时刻的姿态参数为:![]()

![]() 是骨架关节角度参数,

是骨架关节角度参数,![]() 为表示变形、骨骼长度等的参数;这样,人体表面可以表示为由

为表示变形、骨骼长度等的参数;这样,人体表面可以表示为由![]() 唯一确定的等势面。

唯一确定的等势面。

2.2 人体姿态参数的降维及聚类

一般来说,三维人体模型需要较多的自由度才可以相对逼真的呈现人体运动,因此![]() 是一个高维参数(这里略去

是一个高维参数(这里略去![]() )。我们使用CMU运动捕获数据库中的运动捕获数据,对运动参数使用PCA降维后,每个时刻的关节运动参数可表示为:

)。我们使用CMU运动捕获数据库中的运动捕获数据,对运动参数使用PCA降维后,每个时刻的关节运动参数可表示为:

图1 姿态参数的前三主元空间表示

![]() (1)

(1)

其中:![]() 为全序列的平均值,

为全序列的平均值,![]() 为主元矩阵,

为主元矩阵,![]() 是t时刻

是t时刻

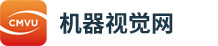

的主元权值向量。实验中,关节运动参数的维数可降至5维,即(![]() ),前五个主元的数据方差可以占到总方差比例的90%以上。 图1为运动捕获序列数据的前三主元空间表示, 图2是姿态参数的前6主元坐标。

),前五个主元的数据方差可以占到总方差比例的90%以上。 图1为运动捕获序列数据的前三主元空间表示, 图2是姿态参数的前6主元坐标。

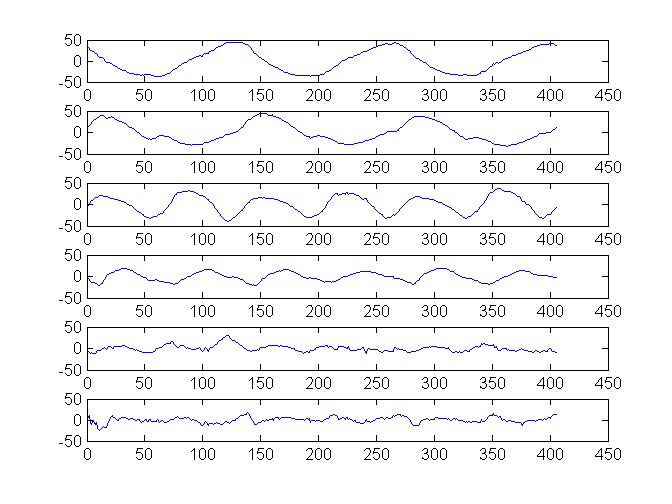

降维后姿态空间的维数虽然大大缩小了,但对于复杂的人体运动而言,有效搜索空间依然很大,由于大部分的人体运动都是有规律的周期运动,所以可通过聚类的方式继续分割整个低维运动参数空间,分割后的每个子空间与特定的运动阶段对应。本文中的子空间数为 4,使用的聚类方法为k-means聚类法。从图3中可以看到,与相同运动阶段对应的运动参数被划为同一类。这样的聚类也是寻找一个特定运动序列中的关键帧的有效方法,图4所示是聚类中心的姿态参数对应的三维人体骨架姿态。

图3 运动捕获数据序列的聚类结果,图中上面的两条

平滑曲线表示随着时间变化的关节运动角度参数,

下面的阶梯状折线表示聚类结果,处于相同

阶梯的参数被划为同一类

图4 与各聚类中心对应的人体三维骨架姿态。图中的

人体运动捕获数据来源于CMU运动捕获数据库中的

行走序列。 可以看出,每幅子图中的人体姿态

都对应于行走过程中的关键阶段

2.3 高斯混合模型重建人体三维姿态

高斯混合模型(GMM)在前景检测、图像主体的跟踪方面使用较多[7, 8],主要用来对场景的变化进行统计建模。对于三维姿态重建来说,姿态参数的分布可以由以下混合密度表示:

![]() (2)

(2)

其中![]() 表示每个时刻姿态参数类的权值,

表示每个时刻姿态参数类的权值,![]() 分别表示每类姿态参数的均值和方差,

分别表示每类姿态参数的均值和方差,![]() 为聚类数。在降维聚类都完成后,人体姿态参数可以看作是低维空间中的具有多峰分布(“峰”的数目与聚类数相关)的随机变量,每个“峰”可以用一个高斯分布近似,因此,用高斯混合模型可以准确地描述姿态参数的分布。任一时刻的姿态参数分布可以由几个已知均值与方差的高斯分布的加权和近似。

为聚类数。在降维聚类都完成后,人体姿态参数可以看作是低维空间中的具有多峰分布(“峰”的数目与聚类数相关)的随机变量,每个“峰”可以用一个高斯分布近似,因此,用高斯混合模型可以准确地描述姿态参数的分布。任一时刻的姿态参数分布可以由几个已知均值与方差的高斯分布的加权和近似。

3 跟踪框架

本文中的运动人体三维跟踪在生成式框架内进行,生成式方法是人体运动分析中的一种重要方法,生成式重建是自顶向下,即从姿态空间(状态空间)到图像空间(观测空间)的求解方法,其拓扑结构见图5。

图5 生成式重建图模型表示。图中的![]() 是姿态参数时间

是姿态参数时间

序列,![]() 是图像观测序列,生成式重建根据状态先验

是图像观测序列,生成式重建根据状态先验

P(x)以及时域动态模型![]() 生成本时刻的

生成本时刻的

预测状态,再根据![]()

通过匹配更新修正预测以得到最佳的后验状态

这样,在给定观测下人体姿态参数的后验分布为:

![]() (3)

(3)

其中:![]() 为图像匹配似然度函数,

为图像匹配似然度函数,![]() 为状态的预测分布,本文中为高斯混合模型决定的参数分布。

为状态的预测分布,本文中为高斯混合模型决定的参数分布。

似然度函数体现的是图像与姿态参数生成的人体模型合成特征的相似度,是三维运动重建中的关键,也是待优化的指标函数。这里我们使用的图像特征为:图像人体的轮廓、轮廓线、细化骨架;与此对应,人体模型的合成特征为隐式曲面的投影轮廓、等势轮廓线、三维骨架的二维投影,最后用粒子滤波器优化似然度函数得到最优的姿态参数。

4 实验结果

实验结果表明:高斯混合密度表示的参数分布不仅可以有效地缩减搜索空间,而且生成的姿态参数预测值都自然地落入有效域内,不会生成不符合人体运动规律的奇异姿态参数值。实质上通过运动捕获数据的运用挖掘出了人体运动的经验模型,自动地满足了人体运动的硬约束。

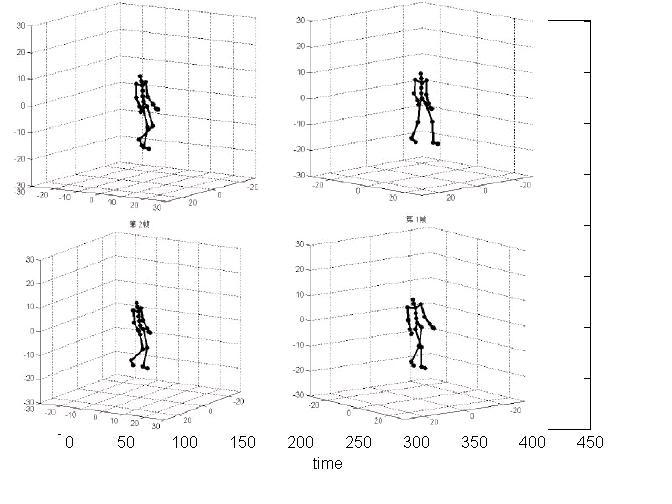

图6显示了人体模型与图像特征的生成式匹配过程。图7给出了人体三维跟踪的结果

图6 人体模型与图像特征的生成式匹配过程,图中的

特征为人体模型的等势轮廓线与图像人体的轮廓线

图7 人体姿态参数的重建结果,左侧为图像,

右侧为三维骨架姿态

5 总 结

在本文中,我们提出了一种基于高斯混合模型的三维人体运动跟踪方法,方法通过PCA降维与聚类的结合,把高维的人体姿态重建问题转化到低维空间中在高斯混合模型的导引下解决。具体的求解在生成式框架内进行。实验结果证明了方法的有效性。

下一步我们将在高斯混合模型的基础上继续对序列图像的时域动态模型做深入研究,从生成式求解转到计算开销相对较小的诊断式求解,拓宽样本序列的选择,使模型适合更广泛的运动样式。

参 考 文 献

[1] R. Urtasun, D. J. Fleet, P. Fua. Monocular 3D tracking of the golf swing. Presented at CVPR, 2005.

[2] R. Urtasun, P. Fua. 3D Human Body Tracking using Deterministic Temporal Motion Models. Presented at ECCV, 2004.

[3] J. Rittscher, A. Blake. Classification of human body motion. 1999.

[4] A. Agarwal, B. Triggs. Tracking Articulated Motion using a Mixture of Autoregressive Models. Presented at ECCV'04, 2004.

[5] T. B. Moeslund, E. Granum. A Survey of Computer Vision-Based Human Motion Capture. Computer Vision and Image Understanding: CVIU, vol. 81, pp. 231-268, 2001.

[6] M. Tong, Y. Liu, T. Huang. Recover Human Pose from Monocular Image Under Weak Perspective Projection, vol. 3766: Springer-Verlag GmbH, 2005.

[7] M. Harville, G. Gordon, J. Woodfill. Adaptive video background modeling using color and depth. 2001.

[8] C. Stauer, W. Grimson. Adaptive background mixture models for realtime tracking. Presented at CVPR, 1999.

- 上一条:基于机器视觉的弹簧自动检测系统

- 下一条:一种压缩视频中的隐写算法