- 10/09

- 2020

-

QQ扫一扫

-

Vision小助手

(CMVU)

据麦肯锡预计,到2025年,全球人工智能应用市场规模总值将达到1270亿美元,人工智能将是众多智能产业发展的突破点。不过,目前对于人工智能的智能化水平还没有统一的标准。目前,人工智能已广泛用于自动驾驶、智能家居、工业生产、智慧农药等各个生产生活场景中。

人工智能的发展主要分为三个层次,即运算智能、感知智能和认知智能。人工智能的发展主要分为三个层次,即运算智能、感知智能和认知智能。所谓智能感知,不仅包括通过各种传感器获取外部信息的能力,也包括通过记忆、学习、判断、推理等过程,达到认知环境和对象类别与属性的能力。所谓智能决策,是指在对环境和对象智能感知的基础上,为达到某种目的,经过再次记忆、学习、判断、推理等过程,给出行为决策的能力。

9月25日上午,安森美半导体召开媒体交流会。会上,安森美半导体智能感知部全球市场和应用工程副总裁易继辉向媒体,介绍了安森美半导体智能感知策略及方案。

据介绍,安森美半导体的智能感知策略主要侧重于在汽车、机器视觉和边缘人工智能这三个方面。本文主要介绍安森美感知技术在汽车行业的应用。

汽车行业是属于非常传统和老旧的行业,但是近几年,由于电力化和智能化,使这个行业产生了新的动力,特别是智能化,各种感知产品的应用,使汽车变得更加安全、更加舒适。安森美在汽车的智能感知方面的成长速度,远比汽车本身的成长速度快得多,就是因为汽车采用新技术的速度非常快。

机器视觉也是一个很历史悠久的行业,因为工业4.0时代,再加上自动化、人工智能的导入,使这个行业有了新的动力、新的活力,成长速度也非常快。特别是在中国,机器视觉这几年的发展非常快。

边缘人工智能是新兴市场,主要是由人工智能、5G、IoT等新技术导入后开发出新的应用。据易继辉介绍这个行业发展非常迅速,经常隔几天、隔几个礼拜就会有新客户打电话来说他们有新的想法和应用,希望得到帮助。这是非常有潜力的市场。在这些核心市场上,安森美已经做了非常长时间的布局和投入。

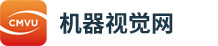

安森美半导体为整个汽车提供全面的智能感知方案

易继辉认为,汽车是四个轮子上具有极强感知能力的计算机。为什么呢?过去几年,ADAS摄像头、倒车摄像头、环视360度、监控、电子车镜、驾驶员监控、乘务员监控、车内的毫米波雷达和激光雷达都已进入汽车。现在最好的汽车感知系统已经远远超过人类的感知,能够不间断地监控周围环境,这是人类驾驶员做不到的。所以未来自动驾驶很可能比人类驾驶更安全,因为感知系统越来越丰富,越来越全面,功能越来越强大。

汽车智能感知方案的关键是满足自动驾驶更高可靠性、安全性的需求。和几年前比,汽车行业已经有了非常大的改变。首先,以前大家买车的标准是经久耐用,在欧美国家,消费者更看中车速有多快,特别是高速公路没有限速的德国。现在,汽车已经不只是经久耐用的产品,特别是未来的自动驾驶和共享汽车,不会再像现在这样一天开两个小时,多数时间停在那里,而是几乎一直在行驶,只有很短时间去充电和维修。

其次,对汽车自动驾驶功能的要求已经不仅是“可靠”,而是需要“可信的汽车”。不只是踩刹车就停那么简单,而是在一些紧急情况下汽车能够自己做出判断和决策,自己采取行动。这就是功能安全。

第三,车联网、智能网联汽车会越来越普遍,如果黑客能够进到车辆感知系统做手脚,危险性可想而知。所以,在国外特别是欧洲,网络安全标准已经开始纳入政府和行业标准。

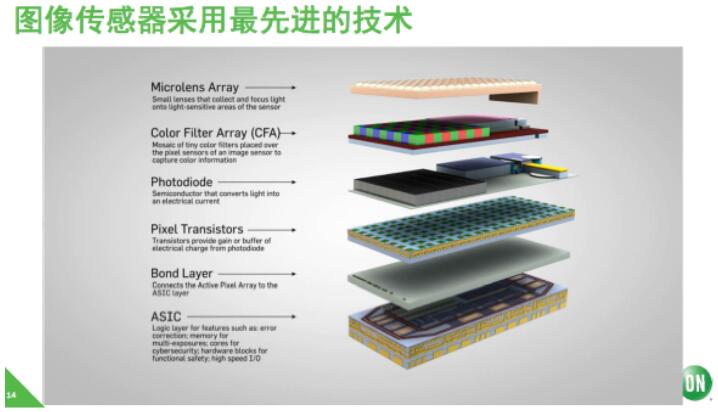

易继辉认为,汽车成像有三个比较明显的挑战:一是超宽动态范围(大于120dB)。开车有时需要逆着太阳,自动驾驶时,这种情况对摄像头的要求非常高。在强光下,汽车从车库、隧道出来,如果宽动态不够,根本无法看到暗处。

二是温度范围超大(-40℃至+105℃)的环境条件,不管是零下几十度的环境,还是高温环境都要适应。

三是图像传感器要辨别LED指示牌、交通灯。现在中国、欧洲、美国、日本等国家的公路都已开始使用LED电子管控牌,人老远就可以看得清清楚楚,特别是夜晚。但因为LED闪烁频率没有标准,图像传感器容易因频率不同步捕捉不到信号。以往的方案是用软件来解决,现在的解决方案可以在芯片级直接实现。

汽车成像的三大挑战

在汽车自动驾驶场景中,成像需要满足多样化的要求,包括外部感知、内部感知和增强视觉。外部感知非常复杂,包括远近、大小车辆、自行车;行人(大人、小孩、老人);路标、车道线、斑马线、交通灯;白天、晚上、刮风、下雨、下雪、雾天等全天候;各个季节,如春、夏、秋、冬都要能够实现感知。

内部感知,最早是看驾驶员眼睛和睫毛的抖动监测是否疲劳,现在逐渐扩大到驾驶员有没有使用手机,分散精力,是否系好安全带,并进一步扩大到乘客感知。这将是未来一个新兴的市场。

视觉增强主要是为驾驶员和乘客提供更好的视觉感知,包括电子后视镜,不需要回头就能在后视镜直接看到真正的电子图像;而且可以把高清地图和真实路况叠加起来,发现哪里有加油站,哪里有重要景点,哪里有红绿灯。

多样化的成像

在汽车感知市场,安森美半导体的图像传感器在ADAS和AD领域市场份额超过80%,2019年付运约1亿颗传感器。其中包括采用HayabusaTM新技术,同时提供汽车高动态范围及减少LED闪烁的产品,以及全球第一个可实现网络安全的图像传感器,并同时开拓毫米波雷达和激光雷达市场。汽车成像市场的份额也相差不多。

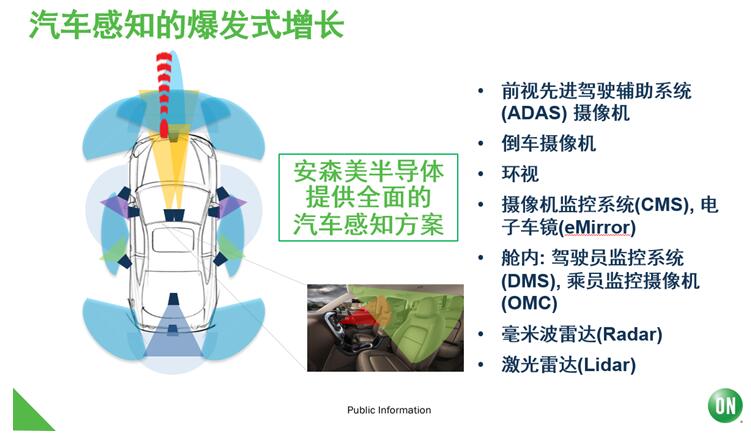

安森美半导体的图像传感器采用六层内部结构,都是由半导体制成。易继辉说,它要比制造GPU和CPU的挑战性和难度更高,需要长时间的技术积累和投入。因为GPU和CPU处理的主要是电子(Electron);而图像传感器既要处理电子又要处理光子,电子和光子的结合使图像传感器成为非常复杂的半导体器件。未来还会通过更多芯片的叠加将人工智能直接集成在图像传感器中。

六层半导体结构的图像传感器

为了增加动态范围,利用Hayabusa技术在传统小像素旁边开个大的蓄水池,可以把多余的电荷存起来,增强了光量,提高了信息量,一次曝光就能实现95dB,这是非常了不起的进步。经过多次曝光可以达到120dB,未来的下一代产品一次曝光能够达到110dB,多次曝光可以达到140dB,这是整个行业领先的一个指标。起初,该技术用在好莱坞导演都非常喜欢用的高端、专业摄影机中,现在这个技术已应用于汽车传感器及工业机器视觉等领域。

对汽车应用来说,宽动态非常重要。在动态不好的情况下,照顾了暗的部分,亮的部分就丢失了。宽动态好,不仅暗的地方看得非常清楚,亮的地方,包括红绿灯、前面的车辆都能看得很清楚,这就给人工智能算法提供了非常准确和丰富的信息,有助于做出非常准确和安全的判断。

不同动态范围对比

在动态范围102dB的车灯场景,可以清楚地看到旁边的一个行人;如果传感器动态范围只有70dB,很多细节就看不出来。所以,使用110dB的传感器才能提供非常详细的信息。

动态范围102dB的车灯场景

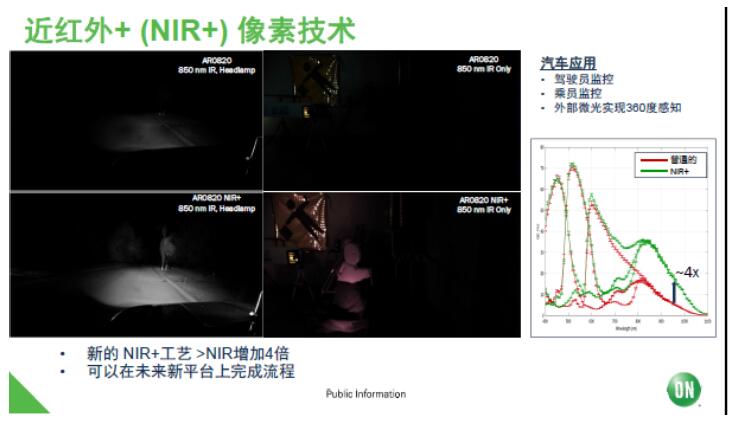

几乎没有灯的夜视条件,就相当于一个暗室。新一代产品采用近红外+(NIR+)像素技术,近红外光电转换效率提高了4倍,能够捕捉到更多信息。将这一技术用于汽车,有助于避免事故,保证安全。其应用包括驾驶员监控、乘员监控、外部微光360度感知等。

近红外+(NIR+)像素技术能捕捉更多细节

当前,国内主机厂开始越来越重视智能驾驶舱,驾驶员监控应用越来越普遍,包括驾驶员识别、调节座椅位置/空调温度/电台等,还可以在驾驶员离开车后自动发短信,提醒在车里忘记了什么东西。这都是智能驾驶舱可以逐渐提供的一些功能。

智能驾驶舱应用五花八门

智能驾驶舱解决方案需要极佳的红外(IR)响应,才能清晰地看到驾驶员眼睛;还要有极佳的全局快门效率,以获得明亮环境下的受控图像。当然,全面的产品线(如VGA至2MP以上)、强大的软件伙伴关系(应用程序可以根据全局快门产品进行调整),并提供驾驶员监控方案(DMS)参考设计也非常重要。

智能驾驶舱的另一个挑战是尺寸,目前的摄像头尺寸太大,为18×18cm3,最小的也是3×3cm3,安森美半导体和合作伙伴一起开发了一款0.5×0.5cm3的小型摄像头,安装在车里,驾驶员和乘客基本上都不会注意到。在两款百万像素的产品中,AR0144AT图像传感器是业界用量最大的一款。

面对媒体提问如何看待汽车传感器融合趋势时,易继辉表示汽车传感器融合,业界已有很长一段时间的酝酿,但成功的例子并不多。融合会有几个不同的阶段,安森美半导体的重点是Prefusion预融合,真正的融合是在系统里,在MCU或GPU里融合。从图像传感器终端供应商来看,如何做Prefusion,比如有些信号、雷达或激光雷达、图像传感器的校正。现在的难点在于,它在两个不同的位置,获取信号的方式也不一样。很难把它叠加起来,包括将图像信息和深度信息融合在一起。通过我们的Prefusion,现在是逐步地将前端融合信息处理,使它和后端能更好地融合。

此外,计算的算力。做融合需要算力,如果算力功耗太高,算法需要的计算量太大,那么在终端、前端做会有一些挑战性,现在也还处于不断摸索。安森美半导体的优势在于,在业界,图像传感器是一家公司,毫米波雷达是另外一家公司,激光雷达则是另外一个行业,各自互相竞争。而安森美半导体具备这三种方案,并运用在三个方案上的最大优势,在成本、系统上给客户提供最佳的方案,这是我们的一个长期优势。