- 06/07

- 2018

-

QQ扫一扫

-

Vision小助手

(CMVU)

虽然开发基于视觉的机器人系统用于相对封闭的工厂环境可能被认为是一个相对简单的任务,但建立一个用于开放的农业环境(如作物采摘)的系统要复杂得多。

为农业目的设计的基于视觉的机器人系统必须能够捕捉图像,识别作物的颜色、形状、尺寸和纹理,即使照明条件发生变化,也能区分水果与场景的其余部分。 这样一来,他们必须在三维空间中计算果实的位置,并驱动一个或多个机器人抓手从该位置摘取果实。

为了使自动收获作物机器人能够应用到实际问题中,必须准确快速地识别果实。为此,系统的作物识别率必须尽可能高,这对这类系统的开发者来说是一个重大挑战。

尽管有各种各样的成像传感器可用,但过去开发的许多系统识别准确性不高,主要是由于光照不足,遮挡或距离估计不准确几个原因造成的。目前研究人员正在努力克服这些问题,以便他们的作物采摘机器人系统成为现实。

系统的开发者可以从这种基于视觉的机器人系统中的各种各样的图像传感器(3D相机,飞行时间,NIR成像器和超光谱相机)中进行选择,以从场景中收集足够的数据,使系统软件准确地从场景中识别水果的位置。 在一些应用中,可能只需要有限数量的传感器输入,而在其他应用中,可能需要多传感器输入以确定要采摘的位置。

在EU-FP7项目CROPS中,研究开发甜椒收获机器人的研究显示了如何使用Allied Vision Technology的Stingray F201C相机在多个相机位置和视角下捕获水果图像,从而使系统更有效地检测水果。现在,名为SWEEPER的项目将使用CROPS项目中开发的技术来创建一种机器人解决方案,以便在现实条件下收获甜椒(图1)。

捕获特定作物的多个图像可以增加农业视觉引导机器人系统的有效性,从而也可以从场景捕获额外的距离数据。 “在近红外范围内具有高效率的2D相机已经可以为选择正确的水果提供大量信息。 此外,3D技术(通过立体或激光或飞行时间)可为机器人提供深度信息,“Basler(Ahrensburg,Germany)产品管理负责人Renévon Fintel说。”

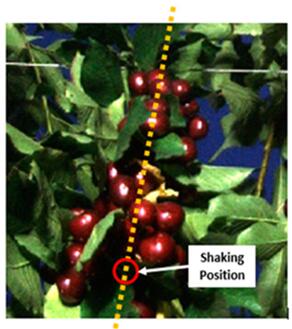

事实上,一般从树上采樱桃时会采用树枝摇动的方式,为了使这一过程自动化,华盛顿州立大学生物系统工程系的研究人员开发了一种基于视觉的系统来定位自动采摘樱桃时的摇动位置,该系统采用了RGB和3D图像捕捉技术。

使用来自FLIR 的Bumblebee XB3立体视觉相机获取树木的彩色图像。 由中央照相机拍摄的RGB图像用于检测树枝和樱桃,而采用PMD Technologies(San Jose,CA)飞行时间(ToF)的3D CamCube相机拍摄深度信息。 首先,树枝和樱桃区域位于2D RGB图像中,之后由3D相机提供的深度信息被映射到上面。 结果是基于视觉的系统能够对摇动位置的数量和位置做出决定并估计它们在冠层中的3D位置(图2)。

当RGB相机提供的对比度不足以实现有效的对象分类时,可以使用多光谱或高光谱成像从场景中额外捕获更多的光谱波段。 事实上,西班牙马德里自动化与机器人研究中心的研究人员采用了这种方法,该研究人员开发了一种基于视觉的系统来检测和定位不同作物的果实。

多传感器系统由Allied Vision Technology Prosilica GC2450高分辨率CCD彩色相机,多光谱成像系统和Mesa SwissRanger SR-400011 TOF 3D相机组成。 RGB照相机和多光谱成像系统提供了水果区域的检测和表征所需的输入数据,而TOF 3D照相机同时快速提供了获取目标的准确距离和强度图像,从而能够定位水果。

获取各种不同的数据类型有助于分类过程,基于视觉的机器人系统开发人员可以使用多种不同的方式来处理获取的数据。 可用于区分水果和背景的比较合适的图像处理方法包括通过深度学习技术分类,通过高光谱成像分割和基于形状的匹配。

在所有这些分析方法中,深度学习技术是目前倍受关注的技术,因为它们可以用来精确地识别水果和蔬菜,并且在场景中能快速地区分它们与其他物体。

例如,使用MVTec软件公司的HALCON软件,用户可以使用卷积神经网络(CNN)训练他们自己的分类器来识别特定类型的产品。 通过向CNN提供足够数量的标记训练图像来进行训练。 软件然后分析这些图像并自动学习哪些特征可用于识别给定的产品。 一旦网络已经被训练完成,新创建的CNN分类器就可以被用来分类新的图像数据。

相比以前要求工程师需要熟练的编程和视觉知识的分类方法,这是一大优势,MVTec HALCON Library产品负责人Thomas Huenerfauth说。

事实上,昆士兰科技大学(澳大利亚布里斯班)的研究人员正在开展一项名为DeepFruits的项目,研究人员已经展示了如何利用CNN将水果与RGB和近红外摄像机获得的图像区分开来。 他们开发的系统的优点之一是可以对其进行再训练,以便非常快速地检测新种类的水果,整个过程每种水果只需4小时。

在基于视觉的机器人采摘机器的开发中,通过图像的捕获和处理以确定产品的位置仅仅是多方面问题的一部分,还涉及到开发一个控制系统,该系统可以与视觉系统一起工作来驱动机器人抓手来抓取产品。

在这个控制系统中,选择什么样的抓手或者是驱动器高度依赖于要采摘的水果的特征。这促进了许多不同类型的夹具和切割装置的开发。软的水果可能要求使用柔软的接触式抓取器,较硬的水果可以由通过真空抓住水果的驱动器拾取,然后旋转水果从树上切断。

作为一名自动化专家,Festo 在EU-FP7项目CROPS开发了两种抓取和切割设备。他们胡椒夹持器上的夹持元件是被动适应性的FinRay手指,以前曾用于Festo的仿生手柄助理 - 一种灵活的手臂模拟大象的躯干,配备一把刀以切割植物上的辣椒。 在苹果夹持器上,夹持元件由膜片钳构成,其通过扭转和拉动或使用压在苹果茎上的无名指将果实与植物分开。

鉴于水果种类的繁多,也许在未来将会开发一种通用的机器人来收割,但是,在接下来的几年中,收割特定水果的专门视觉引导机器人采集系统无疑将会引起重视。