- 12/27

- 2018

-

QQ扫一扫

-

Vision小助手

(CMVU)

现在说机器学习和深度学习的应用只受限于人们的想象力并不夸张。不仅全世界的数据科学家们为之着迷,甚至在日本的农场,一位小哥只为减轻妈妈的工作负担,也开始尝试采用深度学习和Tensor Flow种黄瓜。

什么是深度学习?

要探讨这个问题,我们就要先了解下:人脑是如何学习的?

人类大脑大约由1000亿个神经元组成,神经元之间相互连接形成大约100万亿个突触。对于特定的输入,神经元要么处于关闭状态,要么处于开启的状态。在不断重复关闭-开启的过程中,我们的大脑就会记住这样的过程。

就像我们小时候每天早自习时候做的,不断的背单词的过程中,大脑就会记住某一个单词。但是这样的过程持续的时间不长,如果没有其他辅助记忆的话,差不多中午吃饭前你就忘得差不多了。

▲人类所有的活动、思维,全部都是靠神经元之间的生物电信号传递完成的。

于是乎,当我们看到一个苹果时,无论它是大是小,是国光还是富士,是青色的还是粉红色的,啃过一口还是就剩个果核,氧化铁锈色的亦或是干瘪抽抽的,我们都能第一时间联想到这是Apple。这种联想、想象的能力恰恰是目前机器视觉最需要的,却也是最缺失的功能。

深度学习,就是通过一个算法或者一个数学公式,来模仿神经元关闭-开启的过程,从而让计算机记住某个特征。这样当随便给它一个无论什么样子的苹果,计算机也都能理解这是一个苹果。复杂点的话,计算机甚至可以告诉你这是个什么状态、是否成熟、什么品种的苹果。这样的计算机控制的机械手,可想而知将为全世界苹果园节省下多少劳动力成本。

机器如何进行深度学习?

机器如何进行还是老规矩,我们得知道人脑是如何处理视觉信息的?

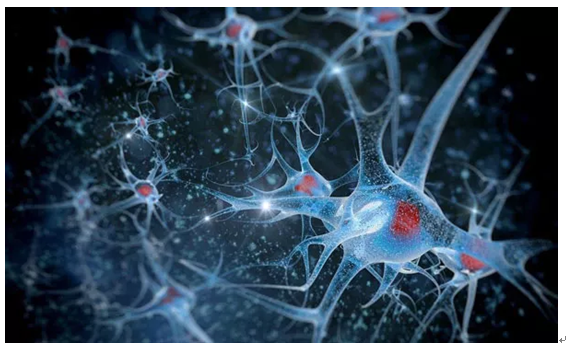

1958年,美国神经生物学家David Hube和Orsten Wiese在一只猫身上的实验证明,人类负责视觉系统的信息处理是分级进行处理的。即当瞳孔接收到图像信号后,大脑皮层内的细胞先来判定物体的边缘和方向,然后由大脑抽象的判定该物体的形状是圆的,最后再进一步抽象的判定出,该物体是一只气球。

这个生理学的发现,直接促成了AI在四十年后的今天突破性的发展。二人也因此获得了1981年的诺贝尔医学奖。

▲先从像素级的V1区提取边缘特征,再到V2区的形状,再到更高层的目标整体、行为分析,人类的视觉系统信息处理走过了一条从低级到高级认知的道路。换句话说高层的特征是低层特征的组合,从低层到高层的特征表示越来越抽象,越来越能表现语义或者意图。而越高层的物体越具体,大脑就越容易识别和判断。

通过对人类视觉系统信息处理机制的模仿,带有神经网络系统的计算机通过成千上万个目标图片进行训练,得到了图像特征。这样我们就得到了一个能够识别该目标的神经网络系统。深度学习?

如何用不到1000美元搭建一套深度学习模型?

刚刚所说的神经网络模型仅仅是针对目标的识别和分类,但实际上它还有更多的用途。比如用户只需要使用很小的流量从互联网上下载一张照片,拥有深度学习能力的手机就可以通过神经网络将图片分辨率提高,从而极大地节约流量节省带宽。

当我们将全国每天数以万计的各种化验报告通过深度学习去训练,神经网络拿到特征之后便可以快速的解读患者的各种化验报告,极大地解放了医务人员的劳动强度。

如果结合AR技术,只要用手机扫一扫桌面上的食物,不但能马上知道食物的原材料、包含营养成分以及热量,更能够避免各种过敏源,让人吃得更加放心。

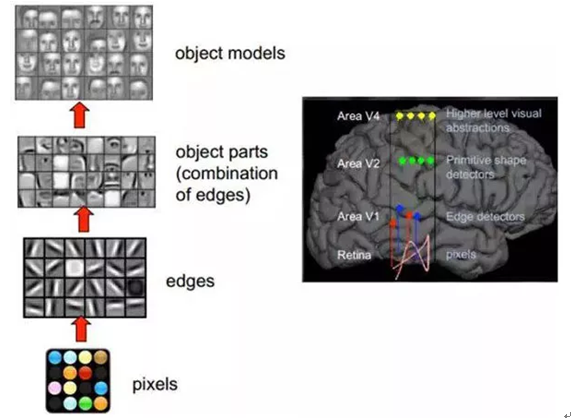

▲通过深度学习,交警现在已经可以通过道路监控识别你的车型、车辆特征、年检标志、风挡前异物、车灯异常或者后89C6镜异常。

一位来自日本的小哥哥MakotoKoike放弃了大城市的高薪工作,一心来到父母的黄瓜种植园帮忙。很快他就发现,相比较于黄瓜的种植难度来说,最费力的是黄瓜分选。

在日本,几乎所有进入零售店的农产品都需要按照标准进行分类售卖,个儿大的、卖相好看的自然卖的贵点,相反就卖的便宜点。在Makoto的农场里,父母按照经验会将收获的黄瓜按照九个等级进行分类。这个过程非常痛苦而漫长,收获时节的高峰期,甚至需要父母花费一整天的时间来甄别每个黄瓜的品相等级。

这项工作父母不愿意额外雇人来分担,因为他们的经验无法分享,只能够在长时间的劳作中自己体会。除了要考虑黄瓜的尺寸、直径,还要看颜色、软硬质地、细小划痕、弯曲程度甚至是黄瓜表面的硬刺大小。实在是只可意会不可言传。

当Makoto决定为父母购置一台自动分拣机的时候,发现要么性能不符合父母的品质要求,要么成本太高小农场无法接受。所以小哥哥决定自己利用深度学习技术,来自己制作一台适合他们家的黄瓜分拣机。

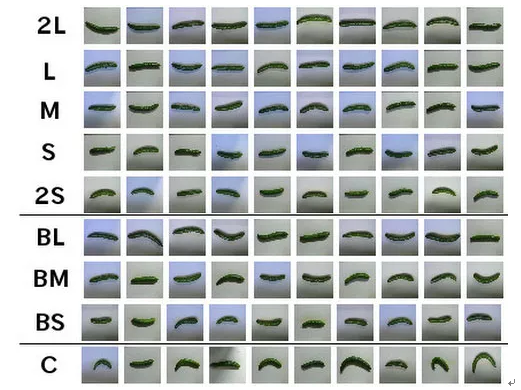

▲根据父母已经挑选出来的9个等级黄瓜,Makoto分别为7000多个黄瓜们采集了图片样本,为自己搭建的分拣机建立神经系统网络做特征识别。

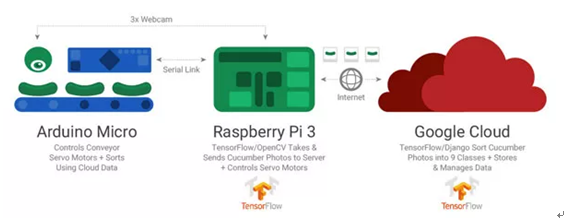

▲这是Makoto自制黄瓜分拣机的系统图。该系统使用Raspberry Pi 3作为主控制器,使用FLIR最新出品的Firefly深度学习&嵌入式开发相机拍摄每一根黄瓜图像。前期该套系统会在Google云服务器上运行TensorFlow神经网络,后期该系统就可以摆脱云图像处理,利用Firefly相机内置的Intel Movidius Myriad 2 视觉处理单元直接进行图像处理,无须工控机或控制器,以实现更高效的分拣效率。

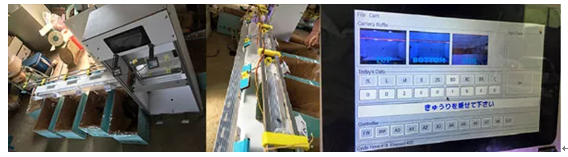

▲小哥哥自产的黄瓜分拣机,以及分拣臂和软件界面的特写。

▲全新Firefly系列相机创造性的将机器视觉与深度学习相结合,专为嵌入式开发或深度学习而生。该系列相机集成了Intel Movidius Myriad 2视觉处理单元(VPU),能够直接在相机上部署训练后的神经网络,彻底抛弃传统主机带来的高成本和低可靠性。全新Firefly系列外形小巧紧凑功率低,非常适合便携式设备或设备集成。

- 上一条:如何为机器视觉系统选择合适的照明系统?

- 下一条:欧盟发布人工智能道德准则草案