- 06/20

- 2016

-

QQ扫一扫

-

Vision小助手

(CMVU)

彭 瑶 孙季丰

摘要:针对图像的融合,本文提出了一种基于SGNN(自生成神经网络)和IHS变换的模糊图像融合方法。新方法首先对图像作IHS变换,得到亮度I、色度H、饱和度S三个分量;然后,利用SGNN模糊聚类方法融合图像的亮度分量,并用融合后的图像替代原图像的亮度分量;最后,作IHS反变换得到新的图像。通过试验结果和数据显示,可以看到新方法在性能方面有优越性,优于简单的IHS变换和SGNN图像融合方法。

关键词:SGNN; 图像融合; IHS变换; 聚类分析

1.引言

图像融合是将两个或者两个以上的传感器在同一时间(或不同时间)获取的关于某个具体场景的图像或者图像序列信息加以综合,生成一个新的有关此场景的解释,而这个解释是从单一传感器获取的信息中无法得到的。随着遥感技术的发展,获取的同一地区的遥感图像越来越多,它们可以是多分辨率的、多时相的、多光谱的、多传感器的,也可以是多平台的。与单源遥感图像相比,多源遥感图像所提供的信息既有互补性,合作性,也具有冗余性.图像融合的目的就是突出有用的信息,抑制无关的信息,以弥补单一图像的不足,从而达到多源图像所提供的相互补充。这样不仅扩大了各图像的应用范围,而且有利于增强多重数据分析和环境监测能力,改善遥感信息提取的精确性和可靠性。

在遥感图像融合中,IHS变换法是最为常用也是最为基本的方法。一般来说,基于IHS变换融合法可以提高融合影像的空间细节表现能力,但光谱失真较大。

另外,由于神经网络可以灵活模拟各种非线性特征,而事前不需要了解非线性特征的知识[1,2]。近年来神经网络开始用于遥感多传感器图像数据的分类。2005年鲍复民等人提出将SGNN(自生成神经网络)应用于图像融合[3],取得了较好的效果。

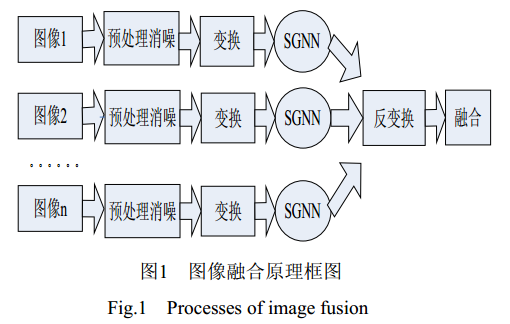

本文中给出了一种基于SGNN和IHS变换的像素级图像融合方法。该方法按照像素级融合的一般过程可以分为四步:第一步是图像的预处理,我们运用简单的滤波方法完成了对图像的消噪。第二步对图像进行了IHS变换。第三步是综合阶段,我们采用了加权法,运用SGNN自生成神经网络来完成对变换结果的综合处理。第四步完成反变换阶段,得到最终的融合图像。由于我们在IHS融合算法中改变了直接取代I分量的方式,通过选取SGNN融合算法,并用融合后的图像来替代I分量,从而使最终融合的影像在多光谱信息的保持与空间细节信息表现能力的综合性能得到提高。

本文所使用的融合方法原理框图如下所示:

一般情况下,成像系统获取的图像由于受到种种条件限制和随机干扰,往往不能直接用来进行融合,因为这样必然导致噪声融入融合结果。对原始图像进行滤波去除噪声可对最终结果有一定的改善。

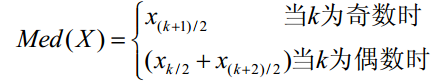

中值滤波器的基本思想是用像素点领域灰度值的中值来代替该像素点的灰度值,该方法在去除脉冲噪声、椒盐噪声的同时又能保留图像边缘细节。若  为滤波器内的元素,

为滤波器内的元素, ![]() 表示中值滤波函数,则有:

表示中值滤波函数,则有:

![]() (1)

(1)

其中MED表示对 按大小排序后取均值。即下式所示:

按大小排序后取均值。即下式所示:

(2)

(2)

X表示按 ![]() 大小排序后的集合。

大小排序后的集合。

3.融合过程

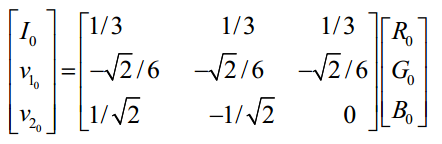

3.1IHS变换

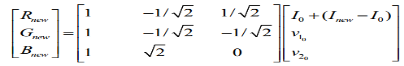

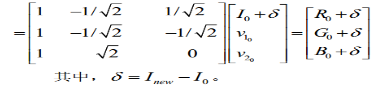

本文中,我们对图像进行GIHS变换,得到每幅图像的I分量,然后运用SGNN将图像的I分量进行融合,获得新的![]() ,然后在原始图像的R、G、B成分上加上修正量

,然后在原始图像的R、G、B成分上加上修正量![]() 。然后进行反变换得到最终的融合图像。

。然后进行反变换得到最终的融合图像。

第一步:

(3)

(3)

第二步:用![]() 代替

代替![]() ,这里出现的

,这里出现的 ![]() 是利用后面介绍的SGNN聚类分析的方法得到的。

是利用后面介绍的SGNN聚类分析的方法得到的。

第三步:反变化得到最后的融合结果。

(4)

(4)

3.2基于SGNN的像素级融合方法

SGNN(self-generating neural network,自生成神经网络)是Wen等人于1922年首先提出的,在这之后Inoue等人对SGNN的应用进行了较深入的研究[4]。SGNN是自组织神经网络(SONN)的一个扩展[5],具有网络设计简单,学习速度快的优点。本文用SGNN作为聚类器对图像的亮度分量按像素进行聚类。

1.简单聚类

考虑一幅 ![]() 个像素的图像,我们以图像的像素作为输入样本集,其I分量的值作为样本的属性值。

个像素的图像,我们以图像的像素作为输入样本集,其I分量的值作为样本的属性值。

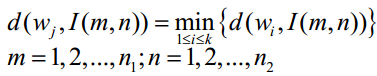

以I(m,n) 表示坐标位置 (m,n)为的像素的I分量值,假设将图像像素分为k 类,其中第j类![]() 的中心值为

的中心值为![]() ,则对属于第j类的像素,应满足

,则对属于第j类的像素,应满足

(5)

(5)

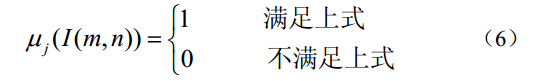

2.聚类结果的模糊化

经由上面的SGNN聚类,图像中每个像素都属于一个确切的类,以![]() 表示坐标位置为(m,n) 处像素的隶属度,

表示坐标位置为(m,n) 处像素的隶属度,![]() 的下标就表示该像素属于j 类。

的下标就表示该像素属于j 类。

我们引入模糊化隶属度,把![]() 的取值范围由

的取值范围由![]() 变为

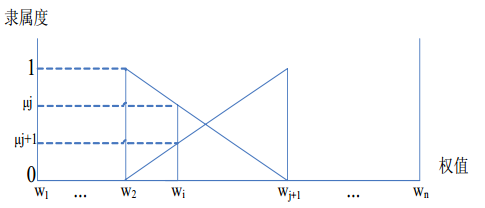

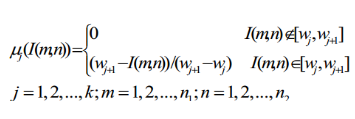

变为![]() ,也就是说一个像素不再属于一个确定的类,而是以不同的程度属于各个类别。本文采用三角形隶属函数。如下图所示,该函数的定义为:

,也就是说一个像素不再属于一个确定的类,而是以不同的程度属于各个类别。本文采用三角形隶属函数。如下图所示,该函数的定义为:

图2 模糊隶属度求解

Fig.2 Schematic diagram of membership function

(7)

(7)

其中, ![]() 和

和![]() 分别是第j 类和第j+1 类的中心的权值。

分别是第j 类和第j+1 类的中心的权值。

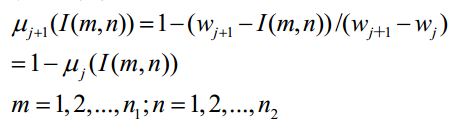

(8)

(8)

即当(m,n) 处的像素的亮度分量值I(m,n) 处于![]() 之间时,这个像素对

之间时,这个像素对![]() 和

和![]() 的隶属度可用 分别带入式(7)和式(8)求得。由以上两式可知:

的隶属度可用 分别带入式(7)和式(8)求得。由以上两式可知:

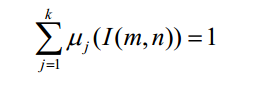

(9)

(9)

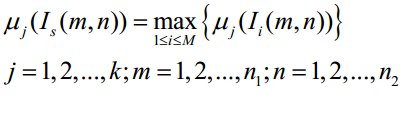

3.融合

假设有M幅个 ![]() 像素的原始图像用于融合,

像素的原始图像用于融合,![]() 表示第I 幅图像(m,n) 处的分量值,

表示第I 幅图像(m,n) 处的分量值, ![]() 为第 I幅图像(m,n) 处的像素对第j类的隶属度,我们对相同位置的像素取其对j类的最大隶属度:

为第 I幅图像(m,n) 处的像素对第j类的隶属度,我们对相同位置的像素取其对j类的最大隶属度:

(10)

(10)

融合所得的I分量结果我们由加权平均法求得:

(11)

(11)

3.3IHS反变

经过SGNN我们得到最后的融合I分量,利用3.1的第三步IHS反变换方法我们得到最后的融合结果。

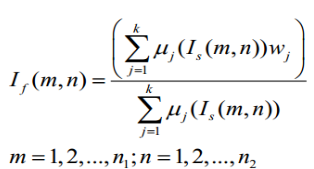

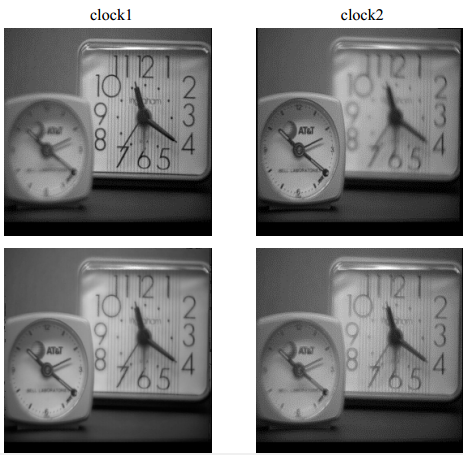

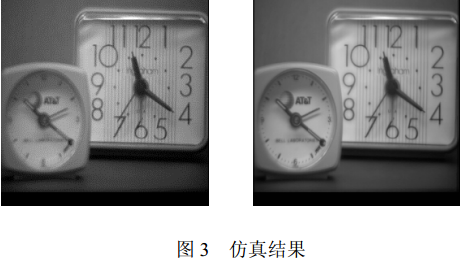

4.仿真结果

为简单起见,我们取两幅256×256的图像,分别运用SGNN、IHS、本文中使用的方法以及小波的融合方法[7]对其进行融合试验。从图中可以看出,新方法的融合结果图很好的综合反映了两幅原始图像的特征。

Fig.3 Simulating results

我们使用以下几种统计参数来评价融合效果:

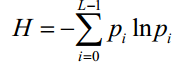

(1)信息熵

对于灰度范围![]() 的图像直方图,

的图像直方图, ![]() 为灰度值等于 i的像素数与图像总像素数之比,L 为灰度值总数,其信息熵定义为

为灰度值等于 i的像素数与图像总像素数之比,L 为灰度值总数,其信息熵定义为

(12)

(12)

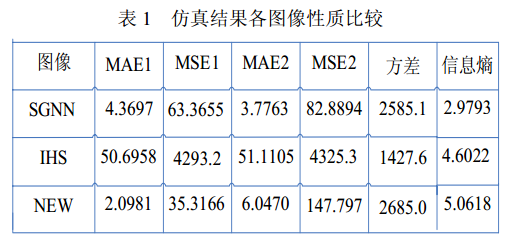

图像信息熵反应了图像携带的信息量的多少。图像的熵值越大,说明携带的信息量越大。从表1我们可以看出,新方法的信息量高于简单的IHS变换和基于SGNN的图像融合方法。

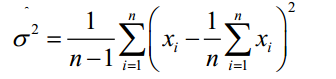

(2)方差

在统计理论中,方差定义为

(13)

(13)

方差越大则灰度级分布越分散,从而包含的信息量越大。表1显示出,新方法所得到的方差高于前两种方法。

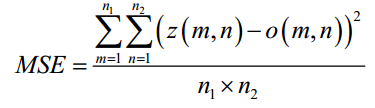

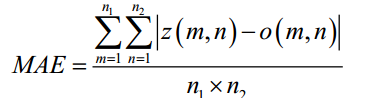

(3)MSE和MAE的定义如下:

(14)

(14)

(15)

(15)

n1,n2是图像的长和宽,Z(m,n) 是被比较图像像素的灰度值, O(m,n)是原始图像的灰度值。

表1给出了仿真过程各图像的性质,由表可以看出,新方法在性能方面有一定的优越性。

5 结束语

针对图像的融合,本文提出了一种基于SGNN自生成神经网络和IHS变换的图像融合算法,它通过对图像进行IHS变换并采用SGNN聚类方法对图像的I分量进行融合,能很好的完成对图像的融合。由结果可以看出,这种新方法在性能方面优于简单的IHS变换和基于SGNN的图像融合方法。

参考文献

[1] Smart license plate recognition system based on image processing using neural network, Koval.V; Turchenko.V; Sachenko.A; Markowsky.G, IEEE International Workshop on Intelligent Data Acquisition and Advance Computing Systems:Technology and Applications 2003, Lviv. Ukraine

[2] An image fusion algorithm based on RBF neural networks, Li-Qun Gao; Rong Wang; Shu Yang;,Proceedings of the Fourth International Conference on Machine Learning and Cybernetics,2005

[3] 基于SGNN的图像融合,鲍复民,李爱国,覃征,计算机研究与发展,ISSN/CN/TP42(3):417-423,2005

[4] Effective online pruning method for ensemble self-generating neural networks, Inoue.H; Narihisa.H, The 47th IEEE International Midwest Symposium on Circuits Systems: 10.1109/MWSCAS.2004.1354297

[5] Self-organizing neural grove and its applications, Inoue.H; Narihisa.H, Proceedings of International Joint Conference on Neural Network,Montreal,Canada,July 31-August 4,2005

[6] IEEE CNF, Approach to recognition of license plate numbers using neural networks, Paily.I; Turchenko.V; Koval.V; Sachenko.A; Markowsy.G, IEEE International Joint Conference. July 2004

[7] Image fusion using a 3-D wavelet transform, Nikolov., S.G;Bull, D.R; Canagarajah, C.N; Halliwell, M.; Wells, P.N.T., Image Processing And Its Applications,1999.Seventh International Conference

[8] A comparative analysis of image fusion methods, Zhijun Wang; Ziou.D; Armenakis.C; Li.D; Qingquan Li, IEEE Transactions on Geoscience and Remote Science: 10.1109/TGRS.2005

- 上一条:基于灰度图像的车牌定位算法的研究

- 下一条:基于导航系统的抗变形图像匹配算法研究