- 分类:

-

全部 镜头 相机 传感器 采集卡 光源 传输及线材 系统产品 智能设备 解决方案 软件算法及深度学习 集成及工业计算机 机器人及机械臂 3D产品 行业综述 其他

展开

- 行业:

-

全部 汽车 芯片半导体 检测 电子组装 精工和光学 铁路 监控 安防 医疗 包装 光伏太阳能 航天航空 军事国防 LCD触摸屏 物流及拆码垛 药品 烟草 纺织 读码及识别 锂电 教学及科普 化学 陶瓷 纸张 木材 玻璃 农业 印刷 食品 造船 勘探 铁和金属 显微镜及生命科学 可回收资源 可再生资源 塑胶塑料 摄影测量和遥感 化妆品 电信 电力 智能交通 三维测量 体育 其他

展开

-

赋能绿色能源未来:能源巨头以高精度测量机护航LNG运输安全

在全球清洁能源运输行业中,LNG(液化天然气)因其环保特性日益重要,而LNG储罐核心部件的质量直接关系到运输安全和能效。作为韩国领先的LNG储罐部件制造商,TMC(前身为Samwoo Memco)近期完成一项关键的技术改造,通过升级三坐标测量机(CMM)显著提升质检能力,进一步巩固了其行业领先地位。精工和光学监控物流及拆码垛2025-09-30 | 中国机器视觉网 |647 -

无惧脏污+反光!曲轴铸件条码读取so easy

汽车制造商往往使用固定式读码器自动读取产品上二维码,来管理产品上下料、过站、检测等,不 仅速度快,可以大大提高效率,还可以节省劳动力成本。Regem Marr研祥金码创新推出曲轴铸件表面的条码解决方案,助力汽车制造智能升级。检测监控读码及识别2025-09-30 | 中国机器视觉网 |607 -

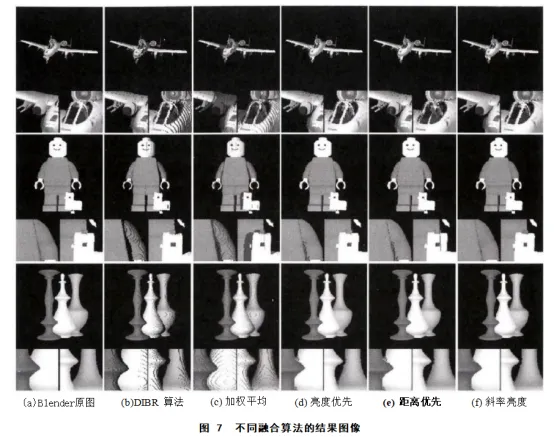

基于EPI融合的光场图像生成与消隐算法

针对全息显示和虚拟现实技术中存在的光场图像质量较低且无法灵活消隐等问题,提出了一种基于EPI(Epipolarplaneimage,极平面图像)融合的光场图像生成与消隐算法。首先,利用视角间的透视相关性减少冗余计算,在EPI坐标系上根据已知相机的RGBD数据对信息进行插值,获得包含密集光场信息的EPI图像。其次,设计了一种斜率亮度融合算法,通过斜率间接对EPI图像中的遮挡物体进行规范,结合亮度信息对EPI图像融合过程中的空洞进行填补。再次,为每一个数据点定义了一个光锥,通过控制光锥内的能量分布,实现光场图像中指定物体的消隐。最后,利用快速行进算法填补因消隐产生的空洞,获得高质量的密集的光场图像。结果表明:该算法在遮挡条件下生成的光场图像质量高于传统融合算法,结构相似度可达99.2%以上,并且实现了光场图像中多物体的消隐。该算法能够利用稀疏的图像数据生成优质且密集的多视角图像,消隐后可以展现更为丰富的多视角图像效果,为动态全息显示和虚拟现实等领域提供了有力的图像数据支持。其他2025-09-28 | 中国机器视觉网 |745 -

医疗容器扫码,“读码专家”三招破难题

目前,大多医疗容器上都会借助机器视觉技术进行条码采集,从而进行信息的录入以及追溯。Regem Marr研祥金码打造医疗容器扫码解决方案,摆脱传统人工手持式扫码低效、高误差、高成本的问题,通过AI算法和大视野智能读码器,显著提升医疗流程的精准性与效率。检测读码及识别2025-09-28 | 中国机器视觉网 |670 -

驱动未来:人工智能与机器学习在下一代汽车中的融合应用

汽车行业正在快速发展,当我们展望最重要的未来技术时,人工智能(AI)与机器学习(ML)无疑占据核心地位。自动驾驶技术仅是冰山一角,当前车辆广泛搭载的安全功能也日益依赖AI与ML技术的驱动。这种融合为提升驾驶体验、安全性、车辆性能与能效带来了全新可能。本文将首先探讨AI与ML在汽车领域的现有应用,并展望其未来潜力。汽车检测2025-09-26 | 中国机器视觉网 |752 -

精准检测新路径:3D 相机在汽车控制器PIN针高度及位置检测中的实践

汽车控制器作为车辆的“神经中枢”,其 PIN针的高度一致性与位置精度是保障电气连接可靠性的核心前提。在实际生产中,PIN针若存在高度偏差或位置偏移,轻则导致回流焊时出现虚焊、接触不良,重则引发控制器功能失效,甚至造成行车安全事故。然而,传统检测方式长期受限于技术瓶颈:人工目检不仅效率低下,更无法识别微米级高度偏差;以及100% 的缺陷覆盖率,而3D 相机检测技术凭借其高精度、高效率、高稳定性的优势逐渐成为汽车控制器 PIN针高度及位置度检测的核心解决方案,彻底打破传统检测的技术困局。汽车检测监控2025-09-26 | 中国机器视觉网 |1044 -

医疗机器人技术:变革患者护理,塑造医疗创新未来

机器人技术正成为医疗健康领域的重要变革力量,它深刻改变了医疗服务提供方式、手术精准度和康复系统体系。随着机器人技术协助精密手术及术后护理,医疗行业正在经历重大转型。本文探讨医疗机器人的当前应用策略,并展望这一发展中的技术领域未来趋势。检测监控医疗2025-09-25 | 中国机器视觉网 |934 -

光子精密光谱共焦位移传感器攻克汽车HUD反射镜轮廓检测难题

抬头显示(HUD)系统是汽车智能座舱的核心组件,可将车速、导航等关键行车信息以悬浮虚像形式投射至驾驶员视野。其中,HUD 反射镜作为关键光学元件,需通过精准曲面设计控制虚像焦距、位置与视场角,若其曲面轮廓存在偏差,将直接导致虚像畸变,影响驾驶安全与信息读取效率,因此对其曲面轮廓的高精度检测至关重要。检测精工和光学2025-09-25 | 中国机器视觉网 |788